No hay forma de negar que las contraseñas son una manera imperfecta y, cada vez más, inconveniente de proteger tus cuentas, pero eso no evita que sigan siendo la primera línea de defensa de la vida digital.

Lamentablemente, la IA, que ha permeado mucho de esa vida, ha complicado aún más el asunto.

Según un estudio de Kaspersky, las contraseñas creadas con ayuda de grandes modelos de lenguaje (ChatGPT, Llama, DeepSeek) emplean a menudo patrones que, aunque indistinguibles para los humanos, las hacen vulnerables, justamente porque están al alcance de otros modelos de IA.

Por eso, son presa fácil de la piratería. Vamos a ver por qué.

Patrones reconocibles

La gestión de contraseñas se ha vuelto tan compleja que muchas personas han empezado a usar estos modelos (LLM, por sus siglas en inglés), como los mencionados anteriormente, para generar contraseñas que aparentan ser seguras.

Pero esta solución, lejos de ser infalible, puede generar una falsa sensación de protección.

Las contraseñas creadas por LLM tienden a seguir patrones lingüísticos reconocibles, lo que podría facilitar su descifrado por parte de atacantes que utilizan herramientas similares para predecir o replicar combinaciones. Además, si una de estas contraseñas cae en manos equivocadas, su reutilización en múltiples plataformas multiplica el riesgo de un ataque masivo.

Alexey Antonov, líder del equipo de Ciencia de Datos en Kaspersky, hizo una prueba y generó mil contraseñas usando algunos de los LLMs más fiables, incluidos ChatGPT (de OpenAI), Llama (modelo del grupo Meta) y DeepSeek (nuevo en China). “Todos los modelos saben que una buena contraseña debe consistir en al menos 12 caracteres, incluidos letras mayúsculas y minúsculas, números y símbolos.

“DeepSeek y Llama a veces generaban contraseñas compuestas por palabras del diccionario, en las cuales, en lugar de algunas letras, había números de forma similar: S@d0w12, M@n@go3, B@n@n@7 (DeepSeek), K5yB0a8dS8, S1mP1eL1on (Llama). Ambos modelos tienden a generar la contraseña 'password': P@ssw0rd, P@ssw0rd!23 (DeepSeek), P@ssw0rd1, P@ssw0rdV (Llama). No hace falta decir que dichas contraseñas no son seguras”.--Alexey Antonov, líder del equipo de Ciencia de Datos en Kaspersky.

Por su parte, ChatGPT no sufre de este problema y genera contraseñas que parecen aleatorias. Por ejemplo: • qLUx@^9Wp#YZ • LU#@^9WpYqxZ • YLU@x#Wp9q^Z • YLp^9W#qX@zv • P@zq^XWLY#v9 • v#@LqYXW^9pz • X@9pYWq^#Lzv Sin embargo, si se observa detenidamente, se pueden ver patrones.

Por ejemplo, el número 9 aparece con frecuencia. Para que las contraseñas sean lo más seguras posible, todos los símbolos deberían aparecer aproximadamente la misma cantidad de veces.

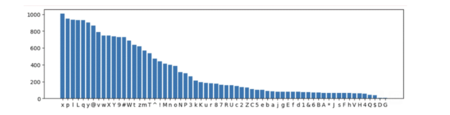

Es algo que se evidencia cuando se pasan los datos a un gráfico como este, que recoge los caracteres y símbolos usados en mil contraseñas generadas por ChatGPT: casi todas contienen los símbolos x, p, l, L...

Frecuencia de caracteres usados en contraseñas generadas por ChatGPT.

Frecuencia de caracteres usados en contraseñas generadas por ChatGPT.

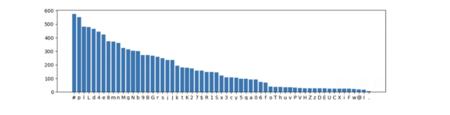

Por su parte, Llama recurre más al símbolo # y las letras p, l, L.

Frecuencia de caracteres usados en contraseñas generadas por Llama.

Frecuencia de caracteres usados en contraseñas generadas por Llama.

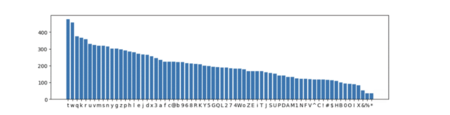

DeepSeek muestra tendencias similares:

Frecuencia de caracteres usados en contraseñas generadas por DeepSeek.

Frecuencia de caracteres usados en contraseñas generadas por DeepSeek.

Además, los algoritmos a menudo no insertan un carácter especial o dígitos en la contraseña: el 26 por ciento de las contraseñas para ChatGPT, el 32 por ciento para Llama y el 29 por ciento para DeepSeek. Así mismo, DeepSeek y Llama a veces generaban contraseñas más cortas de 12 caracteres.

Sabiendo esto, los ciberdelincuentes pueden acelerar significativamente el proceso de prueba de contraseñas por fuerza bruta: es decir, en lugar de probar en orden “aaa”, “aab”, “aac”, ... “aba”, “abb”, “abc”, ... “zzz”, podrían empezar con combinaciones frecuentes.

En 2024, expertos de Kaspersky desarrollaron un algoritmo de aprendizaje automático para probar la fortaleza de las contraseñas y descubrió que casi el 60 por ciento de las contraseñas pueden ser descifradas en menos de una hora usando GPUs modernas o herramientas de descifrado basadas en la nube.

Cuando se aplicó a las contraseñas generadas por IA, los resultados fueron alarmantes, ya que eran mucho menos seguras de lo que parecían: el 88 por ciento de las contraseñas generadas por DeepSeek y el 87 por ciento de las generadas por Llama no eran lo suficientemente fuertes como para resistir un ataque de ciberdelincuentes sofisticados. El porcentaje se reducía hasta el 33 por ciento en el caso de Chat GPT.